¿La IA Generativa está libre de plagio?

Esta entrada está disponible también en los siguientes idiomas: Euskara, English

La discusión sobre si los resultados de la Inteligencia Artificial (IA) generativa pueden ser considerados plagio se ha intensificado a medida que la tecnología ha avanzado. La IA generativa, que incluye modelos como GPT (Generative Pre-trained Transformer) para texto, DALL-E para imágenes, entre otros, tiene la capacidad de crear contenido que parece increíblemente humano en su ejecución. Esta capacidad plantea preguntas legítimas sobre la originalidad y la autoría. Para entender mejor esta cuestión, es útil explorar conceptos fundamentales de machine learning, como la regresión lineal, y cómo fenómenos como el overfitting pueden influir en la percepción de que los resultados de IA son copias o derivados directos de obras existentes.

Regresión Lineal: Fundamentos y Funcionamiento

La regresión lineal es una de las técnicas estadísticas más básicas y ampliamente utilizadas en machine learning para predecir una variable de salida basada en una o más variables de entrada. La idea es encontrar la línea (en el caso de una variable de entrada) o el plano/hyperplano (con múltiples variables de entrada) que mejor se ajuste a los datos. Matemáticamente, esto se logra minimizando la suma de las diferencias cuadradas entre los valores observados y los predichos por el modelo.

La simplicidad de la regresión lineal la hace fácil de entender y explicar, pero también limita su capacidad para manejar relaciones complejas entre variables. A pesar de esto, los principios fundamentales de la regresión lineal se extienden a técnicas más avanzadas de machine learning y AI, como las redes neuronales, que son capaces de modelar relaciones mucho más complejas a través de múltiples capas y nodos (neuronas).

Overfitting: Implicaciones en la Generación de Contenido

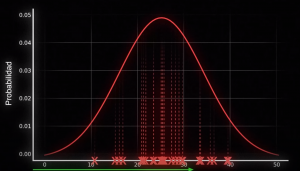

El overfitting ocurre cuando un modelo de machine learning se ajusta demasiado bien a los datos de entrenamiento, hasta el punto de capturar el ruido o las fluctuaciones aleatorias presentes en dicho conjunto de datos en lugar de las tendencias subyacentes. Como resultado, el modelo puede fallar al generalizar a nuevos datos, mostrando una baja capacidad de predicción o generación fuera de su conjunto de entrenamiento.

En el contexto de la IA generativa, el overfitting puede llevar a que los modelos generen resultados que son extremadamente similares a los ejemplos específicos en los que fueron entrenados, en lugar de producir contenido nuevo y original. Esto es particularmente relevante cuando se considera la acusación de plagio. Si un modelo de IA produce obras que son indistinguibles de las existentes, podría argumentarse que ha «copiado» esas obras, aunque el proceso subyacente sea una generación independiente basada en patrones aprendidos.

Plagio y IA Generativa: Una Cuestión de Originalidad

La cuestión de si los resultados de IA generativa pueden ser considerados plagio se centra en la originalidad y la autoría. Un modelo de IA no tiene intención ni consciencia; simplemente procesa y genera contenido basado en los datos y algoritmos que guían su aprendizaje. La IA generativa crea contenido nuevo a partir de la vasta cantidad de información y ejemplos con los que fue entrenada, pero estos resultados pueden reflejar estilos, ideas o incluso fragmentos específicos de las obras de entrenamiento.

La distinción entre inspiración y copia directa es fundamental aquí. En las artes y las ciencias, la inspiración de trabajos anteriores es una práctica común y aceptada. Sin embargo, cuando la salida de un modelo de IA se asemeja demasiado a una obra existente sin atribución, surgen preocupaciones legítimas sobre el plagio. La diferencia clave radica en cómo se manejan estos casos a nivel legal y ético, considerando las limitaciones y capacidades de la tecnología actual.

Conclusión

La discusión sobre IA generativa y plagio es compleja y multifacética. Involucra no solo comprender los fundamentos técnicos del machine learning, como la regresión lineal y el fenómeno del overfitting, sino también cuestiones más amplias de ética, derecho de autor y creatividad. A medida que avanzamos, es crucial desarrollar marcos legales y éticos que reconozcan tanto las capacidades innovadoras de la IA como la necesidad de proteger y respetar la propiedad intelectual y los derechos de autor. La clave será encontrar un equilibrio que fomente tanto la innovación como la justicia.